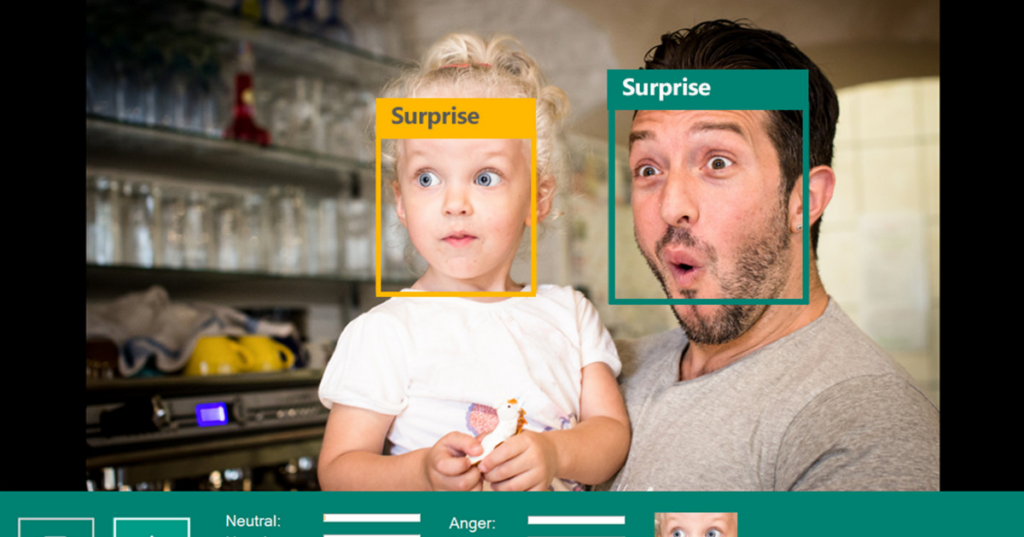

Microsoft stopniowo wycofuje publiczny dostęp do szeregu narzędzi do analizy twarzy opartych na sztucznej inteligencji — w tym jednego, który twierdzi, że identyfikuje emocje osoby na podstawie filmów i zdjęć. Takie narzędzia „rozpoznawania emocji” zostały skrytykowane przez ekspertów. Mówią, że nie tylko wyraz twarzy, który uważa się za uniwersalny, różni się w różnych populacjach, ale że nienaukowe jest utożsamianie zewnętrznych przejawów emocji z uczuciami wewnętrznymi. „Firmy mogą mówić, co chcą, ale dane są jasne” – powiedziała The Verge Lisa Feldman Barrett, profesor psychologii z Northeastern University, która przeprowadziła przegląd na temat rozpoznawania emocji w oparciu o sztuczną inteligencję. „Potrafią wykryć grymas, ale to nie to samo, co wykrywanie gniewu. „Potrafią wykryć grymas, ale to nie to samo, co wykrywanie gniewu”. Decyzja ta jest częścią większego przeglądu polityki etycznej firmy Microsoft dotyczącej sztucznej inteligencji. Zaktualizowane standardy odpowiedzialnej sztucznej inteligencji firmy (określone po raz pierwszy w 2019 r.) podkreślają odpowiedzialność za ustalenie, kto korzysta z jej usług, oraz większy nadzór ludzki nad obszarami stosowania tych narzędzi. W praktyce oznacza to, że Microsoft ograniczy dostęp do niektórych funkcji swoich usług rozpoznawania twarzy (znanych jako Azure Face), a inne całkowicie usunie. Użytkownicy będą musieli złożyć wniosek o użycie Azure Face do identyfikacji twarzy, na przykład informując Microsoft dokładnie, jak i gdzie będą wdrażać swoje systemy. Niektóre przypadki użycia o mniej szkodliwym potencjale (np. automatyczne zamazywanie twarzy na zdjęciach i filmach) pozostaną ogólnodostępne. Oprócz usunięcia publicznego dostępu do swojego narzędzia do rozpoznawania emocji, Microsoft wycofuje również zdolność Azure Face do identyfikowania „atrybutów, takich jak płeć, wiek, uśmiech, zarost, włosy i makijaż”. „Eksperci z firmy i spoza niej podkreślili brak naukowego konsensusu w sprawie definicji„ emocji ”, wyzwania związane z uogólnianiem wniosków w różnych przypadkach użycia, regionach i danych demograficznych oraz zwiększone obawy dotyczące prywatności związane z tego typu możliwościami” – napisał. Dyrektor odpowiedzialny za sztuczną inteligencję Microsoftu, Natasha Crampton, w poście na blogu ogłaszającym tę wiadomość. Microsoft twierdzi, że przestanie oferować te funkcje nowym klientom od dzisiaj, 21 czerwca, podczas gdy dostęp dotychczasowym klientom zostanie odebrany 30 czerwca 2023 r. Aplikacja Seeing AI firmy Microsoft nadal będzie oferować rozpoznawanie emocji. tych funkcji, będzie nadal wykorzystywać je w co najmniej jednym ze swoich własnych produktów: aplikacji o nazwie Seeing AI, która wykorzystuje widzenie maszynowe do opisywania świata osobom z wadami wzroku. W poście na blogu Sarah Bird, główna menedżerka ds. produktów w grupie Microsoft ds. sztucznej inteligencji, powiedziała, że narzędzia takie jak rozpoznawanie emocji „mogą być cenne, gdy są używane w szeregu kontrolowanych scenariuszy ułatwień dostępu”. Nie jest jasne, czy te narzędzia będą używane w innych produktach firmy Microsoft. Microsoft wprowadza również podobne ograniczenia do swojej funkcji niestandardowego głosu neuronowego, która pozwala klientom tworzyć głosy sztucznej inteligencji na podstawie nagrań prawdziwych ludzi (czasami znanej jako dźwięk deepfake). Narzędzie „ma ekscytujący potencjał w edukacji, dostępności i rozrywce”, pisze Bird, ale zauważa, że „łatwo sobie też wyobrazić, jak można je wykorzystać do niewłaściwego podszywania się pod mówców i oszukiwania słuchaczy”. Microsoft twierdzi, że w przyszłości ograniczy dostęp do funkcji do „zarządzanych klientów i partnerów” oraz „zapewni aktywny udział mówcy podczas tworzenia syntetycznego głosu”.

Microsoft wycofuje kontrowersyjne narzędzie do rozpoznawania twarzy, które twierdzi, że identyfikuje emocje

Click to rate this post!

[Total: 0 Average: 0]